如果想無拘無束地生成圖片和影片,很多創作者都會考慮在家架設生成式 AI 平台。ComfyUI 是目前最受歡迎的本地 AI 圖像與影片生成工具,以模組化節點介面聞名,能自由組合 Stable Diffusion、Flux 等大型模型。但近年來,隨著模型規模急速成長(如 Flux 2 Dev 和 WAN2.2 影片模型),本地運行常面臨嚴重記憶體問題。ComfyUI 剛剛就推出了一項新功能 Dynamic VRAM,解決記憶體不足無法生成圖像和影片的問題。

傳統方式下,模型權重需完整載入 VRAM 與系統 RAM,高解析圖像生成或長影片工作流程動輒消耗數十 GB 記憶體,稍有不慎便觸發 OOM(Out of Memory)錯誤。尤其消費者級 GPU(如 RTX 系列)VRAM 有限,生成過程中還需頻繁卸載模型至 RAM,導致 PCIe 頻寬浪費、分頁檔(pagefile)交換變慢,整個流程卡頓甚至崩潰。RAM 價格持續上漲,更讓許多用戶難以升級硬體,本地生成效率大打折扣。

ComfyUI 官方剛剛就正式推出 Dynamic VRAM 功能,已整合至穩定版(NVIDIA 硬體,支援 Windows 與 Linux,未有計劃支援 WSL)。這項革命性記憶體優化系統,透過自訂 PyTorch VRAM 分配器「Dynamic Offloader」,徹底改變模型權重管理方式。核心技術包括:

- Virtual Base Address Register (VBAR):載入模型時僅建立虛擬位址,不佔用實體 VRAM。

- Just-in-Time Allocation:張量 (Tensor) 真正需要時才動態分配物理 VRAM;若 VRAM 不足,自動以臨時張量執行運算後立即釋放。

- 優先權與 Watermark 機制:活躍模型優先保留空間,低優先權權重自動驅逐,避免記憶體抖動(thrashing)。

- 未提交記憶體設計:模型權重以指標方式映射,不進行深拷貝,OS 可隨時回收,載入速度大幅提升。

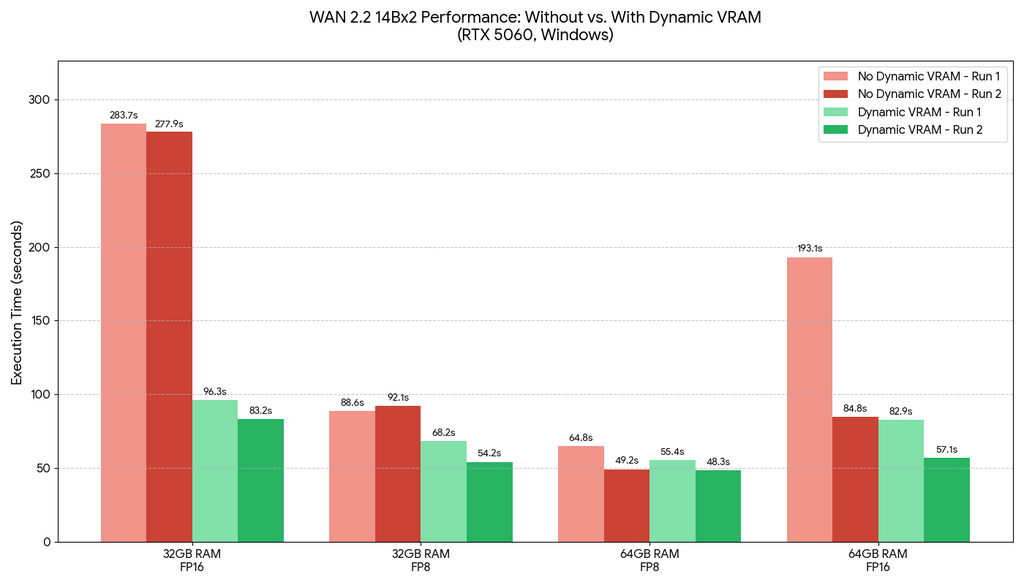

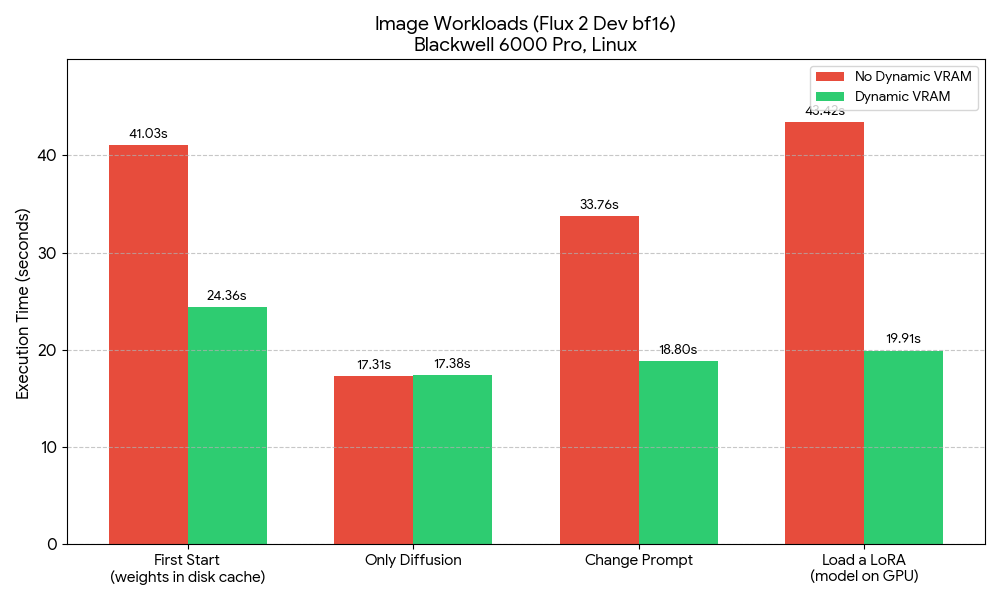

結果顯示,系統 RAM 使用量大幅降低,初始模型載入與 LoRA 應用明顯加速,即使 RAM 不足也能運行大型模型而不依賴慢速分頁檔。VRAM 使用率反而更高,因為系統更有效率地利用最快記憶體。測試中,運行 WAN2.2(56GB fp16 權重)或 Flux 等複雜影片/圖像工作流程,在 32GB RAM 環境下仍能穩定執行,不再出現 OOM 或分頁拖累。

除了 Dynamic VRAM,今個月初 GTC 期間 ComfyUI 還引入了 App Mode,這是另一項重大突破。它能將任何複雜節點工作流程轉變為乾淨、專屬的應用介面:進入 App Mode 後,節點圖完全消失,只顯示使用者需要的輸入欄位(如提示詞、上傳圖片、解析度等),並保留輸出預覽與執行按鈕。一鍵切換模式,毋須額外安裝。搭配 App Builder,創作者可自訂顯示哪些參數、重新命名並分組,讓介面更友好。App Mode 支援分享可執行 URL,接收者毋須了解節點圖,即可在瀏覽器中直接運行,適合分享給客戶、團隊成員或初學者,大幅降低 ComfyUI 的學習門檻,同時保留完整後端功能與擴充套件相容性。