雖然 Meta 最近接連結束多項與 VR 和元宇宙有關的應用和遊戲開發,不過似乎有些研究仍然在繼續進行。Meta 日前發表了一份「大規模編解碼器虛擬化身(Large-scale Codec Avatars,簡稱 LCA)」研究論文,帶來虛擬化身技術的重大躍進。這項來自 Meta Codec Avatars Lab 的創新,利用數以百萬計真實世界影片預訓練,再以高品質攝影工作室數據微調,生成高像真度的全身 3D 化身,可普及化應用。未來將深刻影響視像會議、VR 社交及元宇宙應用。

LCA 論文於 4 月 2 日在 arXiv 發表,首次提出「預訓練 + 後訓練」範式,徹底打破傳統 3D 虛擬化身在像真度與大規模應用之間的取捨困境。傳統多視角攝影工作室數據雖能打造極精細的虛擬化身,卻難以推廣至大量用戶;反之,雖然手機拍攝能大眾化應用,但品質低落。LCA 巧妙融合兩者:先在 100 萬支單人真實環境影片上預訓練,學習廣泛的外觀與幾何先驗;再以數千名受試者的高解析度多視角攝影工作室數據(每人約 5,000 幀、200 台 4K 同步相機)進行後訓練,提升表現力與細節。模型採用可擴展的 3D 高斯散射 (Gaussian Splatting) 架構,結合 Transformer 骨幹與雙分支解碼器,僅需 1 至 4 張輸入影像(甚至手機自拍),即可前饋式生成可動畫的全身虛擬化身,手指動作亦能清楚呈現,推理速度高達每秒 586 幀,極適合即時應用。

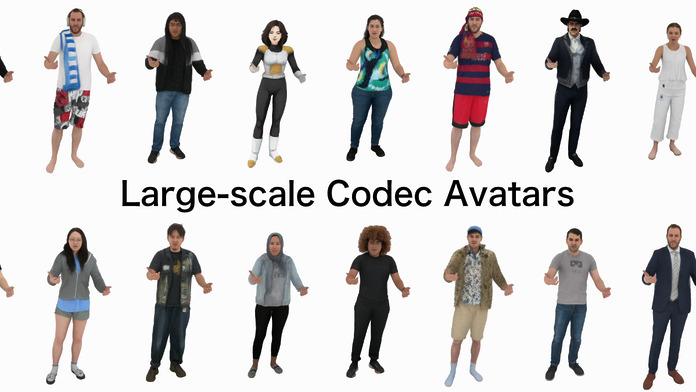

實驗顯示,LCA 可以對應各種髮型、服裝、飾物、種族與年齡,同時可控制精細的面部表情和目光變化、手指關節控制與保留強烈身份特徵。更令人驚豔的是 LCA 提供超強的有效性:即使未直接訓練,仍能支援動態重新打光 (relit)、寬鬆衣物模擬,以及零樣本處理風格化圖像,甚至虛構的人形角色都能應用得到,遠超先前如 ExAvatar 等模型。

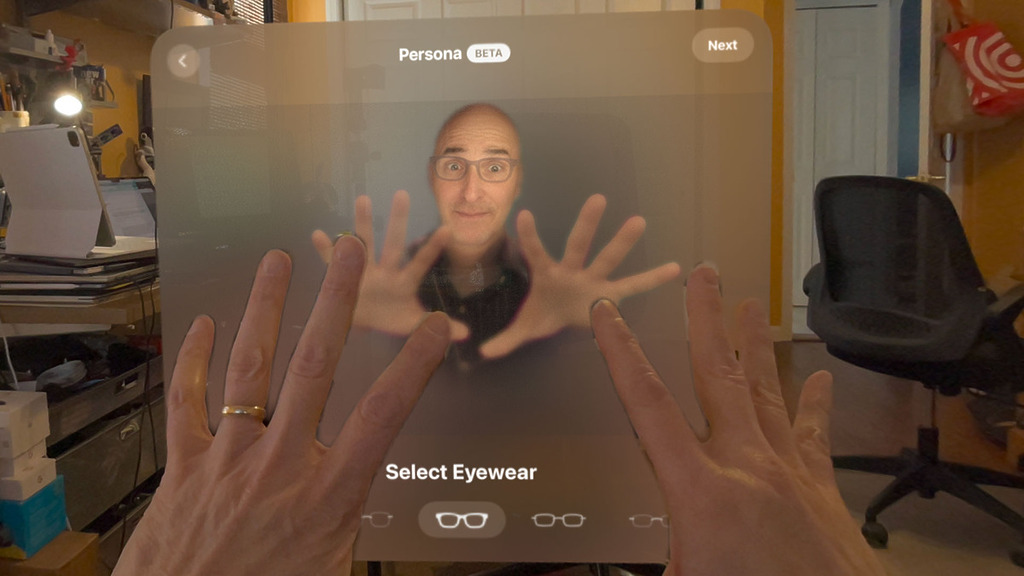

Meta Codec Avatars 系列本就瞄準「沉浸式遠距臨場感」(telepresence),讓 VR 互動如面對面般自然。LCA 進一步將此推向大眾化:未來用戶只需上傳幾張日常照片,即可在 Meta Horizon Worlds、Messenger 或 Quest 頭顯中擁有高像真度全身虛擬化身,取代卡通式 Meta Avatar,可應用在視像會議、VR 場景應用、社交網絡、虛擬試身等應用。

研究團隊強調,LCA 的模組化設計便於未來擴展,雖然目前在細微紋理或快速動作方面仍有待改善,但已為大規模運用奠定基礎。Meta 表示,這項技術最終目標是讓每個人輕鬆擁有高像真虛擬化身,徹底改變人類溝通方式。