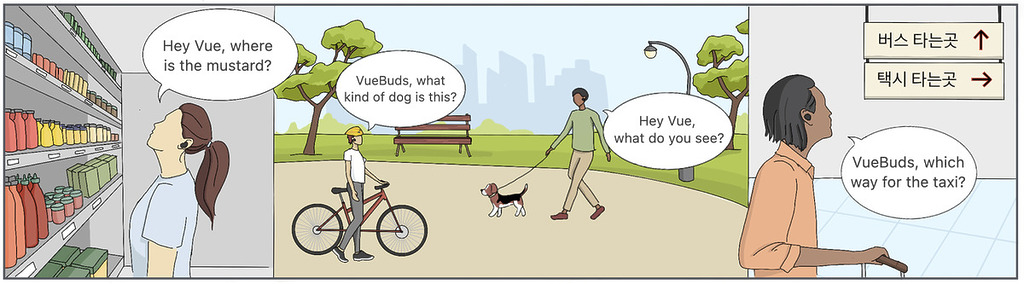

盛傳 Apple 將於今年推出加有紅外線鏡頭的全新 AirPods Pro(或稱 AirPods Ultra)但到底在耳機上加入鏡頭,可以為耳機帶來甚麼功能呢?或者我們可以從 University of Washington 開發的 VueBuds 實驗耳機中找到答案。

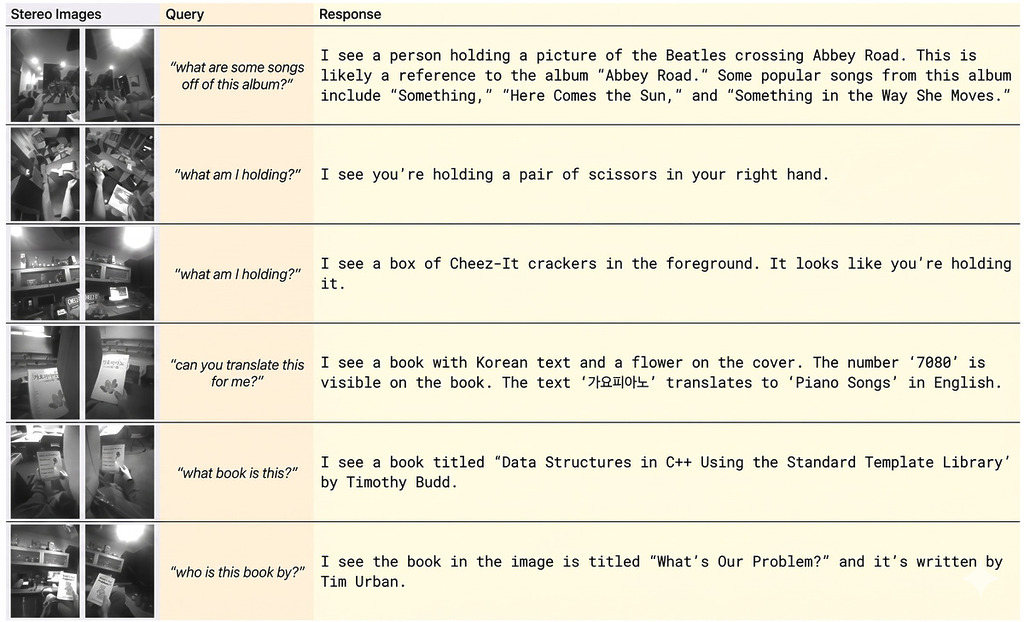

VueBuds 由 University of Washington 研究團隊開發,是採用 Sony 的 WF-1000XM3 進行改裝,在耳機內嵌入微型的黑白鏡頭。系統透過雙鏡頭模擬人類雙眼的立體視覺,將兩側影像整合分析。配合視覺語言模型(VLM) ,讓用戶可以透過語音即時了解眼前事物,為視障人士及日常應用帶來更多可能。基本上用戶只需開口提問,例如詢問告示牌的意思或辨識物件,系統即可即時分析畫面並以語音作回應。研究人員表示,這套視覺語言模型,可提供描述、解釋及翻譯功能。其中的翻譯功能不單是拾取對方的聲音,更會透過鏡頭,捕捉對方的口部動作,從而提升翻譯的準確性。同時鏡頭亦能為用家提供環境的描述,例如用家只要看著書本封面,AI 就可準確說出書目名稱。根據研究測試,在物件辨識及翻譯工作中,VueBuds 準確率約為 83%;在書名及作者識別方面則達 93%。準確度跟市面同類 AI 穿戴裝置相約。

不過由於 VueBuds 採用低解析度黑白鏡頭,只能拍攝低解析度靜態影像,而非高畫質影片,雖然可降低個人數據外洩風險,但缺點是無法回答涉及顏色的問題。加上耳機的低解析度鏡頭和運算能力有限,目前可能無法應付像導航或複雜場景的理解。不過 VueBuds 正因為採用低解析度黑白鏡頭,每個鏡頭耗電少於 5mV,加上採用自動間歇啟動機制來減少電量消耗,所以不會對耳機的電池消耗造成很大負擔。

當然 VueBuds 並不會商品化.但我們仍可透過它來看看未來 Apple 若果真的推出加有紅外線鏡頭的全新 AirPods Pro(或稱 AirPods Ultra),那新耳機可為我們帶來甚麼新體驗。